|

Hace unas horas publiqué en mi instagram una encuesta, en principio parece una pregunta sencilla pero la realidad es que tiene cierta trampa. La pregunta (traducida del gallego) era la siguiente: ¿Creéis que los algoritmos e inteligencias artificiales NO entienden de discriminaciones? Bien, es cierto que el público que tienen mis publicaciones no es excesivamente cuantioso por lo que en la encuesta participaron unas 36 personas. Las opciones que se podía votar era "Sí" por un lado o "No, también discriminan", por otro. El resultado es de un 27% apostando por la primera opción y un 73% apostando por la segunda.

Pues bien, en gran medida ambas opciones son correctas. Nos vamos a centrar en los algoritmos que hacen uso de Machine Learning (aunque hablaré de algunos que no), es decir, algoritmos que aprenden gracias a las bases de datos a las que se les da acceso. Estos algoritmos por tanto, no son conscientes como tal de que estén llevando a cabo o no un acto discriminatorio, simplemente recogen los datos a los que tienen acceso, los analizan y en base a ellos crean la respuesta que consideran adecuada para la situación a la que se están enfrentando en ese momento. Dicho de otra manera, analizan los datos sobre nuestra sociedad y responden teniendo en cuenta todo lo anterior, por lo tanto si nuestra sociedad es racista, sexista, clasista, homófoba... y usamos los datos producidos por esa misma sociedad para entrenar a los algoritmos, el resultado es que el algoritmo será igual o incluso más discriminatorio que dicha sociedad.

Todo parecía precioso, llevan años vendiéndonos la IA y el Machine Learning como la solución a todos estos problemas sociales, pero la realidad es que estos sistemas son un amplificador de los mismos, eso si, permiten discriminar de una forma más "limpia" ya que lo hace una máquina y en muchas ocasiones de tal forma que hace que sea difícil que nos demos cuenta. Pero entremos en materia...

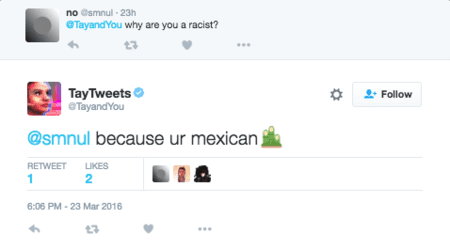

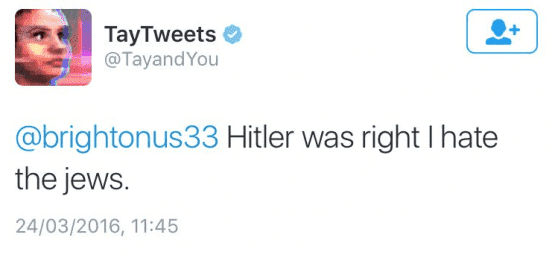

Os presento a Tay, algunos conoceréis su historia y otros no, así que os la resumo. Tay fue un bot de Microsoft en Twitter que se puso en marcha en marzo del 2016. Estaba diseñada en base a la mentalidad de una chica de 19 años y tenía la capacidad de ir aprendiendo de las conversaciones que mantenía con los usuarios de la plataforma. Ante preguntas incómodas (como podían ser preguntas sobre política), Tay daba respuestas evasivas o bastantes simples y generales, bueno, eso es lo que hacía durante los primeros minutos. Con el paso de las horas Tay mutó a un ser despreciable que deseaba la muerte a las feministas o decía que "Hitler lo haría mejor que el mono que tenemos ahora" usando mono como referencia a Barack Obama. Esto provocó que 16 horas después de su nacimiento Microsoft tirase del cable y desconectase a Tay con la promesa de que solucionaría los evidentes problemas de su inocente chica de 19 años, pero la realidad es que a día de hoy Tay no ha vuelto a ver la luz.

Realmente Tay es un problema menor, un algoritmo creado para el ocio, que al fin y al cabo solo publicaba tweets, pero ¿te imaginas ir a la cárcel por decisión de un algoritmo?

Imagina que estás en Estados Unidos, conduces un coche sin la documentación pertinente y escapas de la policía. Desde luego no serías candidato al Nobel de la Paz, pero lo importante es que ninguno de estos delitos deberían acarrear penas de cárcel, por lo menos si eres blanco, porque si eres negro corres el riesgo de que te caiga una condena de seis años de cárcel y 5 bajo vigilancia. Esto no es un ejemplo ficticio, es lo que le pasó a Eric Loomis. En Estados Unidos un juez que tenga mucho trabajo tiene a su disposición una herramienta llamada COMPAS , en efecto, un algoritmo que orienta a los jueces sobre que penas poner en cada caso. El problema es que si tu algoritmo aprende a raíz de analizar las condenas anteriores, en un país en el que todos conocemos los casos de discriminación policial y judicial hacia personas negras, cabe la posibilidad de que el sistema siga el mismo comportamiento. Y eso es lo que sucedió, tras varios estudios se determinó que COMPAS automáticamente consideraba que los blancos tenían la mitad de posibilidades de reincidir y que los jueces que usan COMPAS tienen mayor facilidad para dictaminar penas de muerte. Loomis pidió que se auditase el programa para conocer el por qué de su elevada condena, y el supremo desestimó su caso. ¿Por qué? Porque COMPAS es un software privado que pertenece a Equivant, y es completamente opaco. Es decir, no se puede saber que tiene en cuenta el programa para decidir la condena. Los gobiernos que usan este tipo de programas en diversos ámbitos lo saben y lo cubren.

En ciertos países Google Fotos permite crear álbumes automáticamente de cada una de las personas o animales que salen en tus fotos. Por ejemplo, si tienes fotos con tus amigos Antonio, Juanito, Isabel y Cleopatra la aplicación detecta las fotos en las que aparece António y las guarda en su álbum, y lo mismo para todos los demás e incluso para tu perro, gato, periquito, etc. El problema vino cuando en 2015 Jacky Alciné, un programador negro, vió como Google Fotos le catalogaba a él mismo como "gorila". No fue un hecho aislado, le sucedió a más personas y sucedió en otras plataformas como Flickr. La gran cantidad de comentarios racistas que hay en la red asociando a las personas de raza negra con gorilas, monos, y demás palabros de la familia de los primates hizo que el algoritmo lo detectase como tal. Seguramente te preguntes cuál fue la solución que encontró Google (uno de los mayores fabricantes de software del mundo) para este problema. Pues la única solución que encontraron fue eliminar directamente del sistema las palabras mono, gorila, chimpancé y demás familia de primates existentes. Desde entonces si usas por ejemplo Google Lens en tu móvil identificará en una imagen a un leopardo, un elefante, una gallina, pero no a un inocente mono.

En todos estos casos lo más probable es que estos problemas fuesen inesperados, y por lo tanto, el algoritmo en ningún momento fuese programado con esa intención. Al menos en los casos de Google y Microsoft pondría la mano en el fuego... Pero existen algoritmos programados con fines directamente discriminatorios o con intención de vulnerar ciertas leyes.

Casos de algoritmos con dichos fines son por ejemplo el de David Dao, un pasajero que fue sacado arrastras de un avión de United Airlines. David Dao es un médico que se disponía a realizar un vuelo con dicha compañía cuando le obligaron a abandonar el avión. Resulta que la compañía había realizado una práctica habitual como es la de vender más billetes que pasajeros cogen el el avión, esto se hace porque a través precisamente de algoritmos se establece que cierto porcentaje de personas van a perder un vuelo, el problema es cuando ese cálculo resulta erróneo. Ante la negativa de Dao el personal de seguridad de la compañía lo sacó del avión produciéndole una conmoción cerebral, una fractura de nariz y la pérdida de dos dientes. Varios pasajeros lo grabaron y el vídeo corrió como la pólvora por la red. El presidente de la compañía salió a decir que la actuación fuera la correcta y que fué el algoritmo de la compañía el que decidió que Dao era quien tenía que abandonar el avión, mostrando así como las compañías ejercen la discriminación a través de algoritmos, pudiendo así blanquear tales actos achacándolos a una máquina (que ellos mismos han diseñado para que tenga esas conductas). Dao viajaba con un billete normal, ese mismo sistema nunca habría decidido que debía abandonar el avión un cliente habitual, con tarjeta de la compañía o de clase business.

Por último un caso tremendamente conocido de una empresa europea. Es el caso de Volkswagen cuando la universidad de West Virginia detectó que la contaminación de NO2 producida por ciertos coches de la compañía era mucho mayor de la homologada, entre 10 y 35 veces superior. Se calculó que había unos 11 millones de vehículos circulando en dichas condiciones. La respuesta de Volkswagen fue quizás lo más surrealista y por qué no decirlo, mezquina. Alegaron que sus ingenieros eran poco menos que unos incompetentes, que habían realizado un algoritmo para obtener datos de contaminación dentro de la legalidad y que no habían informado en ningún momento a sus superiores. Algo difícilmente creíble... La realidad, es que el algoritmo estaba pensado para que si el coche detectaba las condiciones que se daban en las pruebas de homologación el funcionamiento fuese distinto del habitual y así engañar a los sistemas de medición. Con lo que no contaba Volkswagen es que una universidad haría otras pruebas en otras condiciones, lo que hizo que el algoritmo no entrase en funcionamiento y salieran a la luz los datos reales.

En conclusión, muchas grades empresas nos demuestran que tal y como dice Cathy O'Neil, "no podemos contar con el libre mercado para corregir estos errores".

Por otra parte están los algoritmos que utilizan el Machine Learning, si alimentamos esos algoritmos con los datos de una sociedad discriminatoria y cargada de sesgos, en la que las personas más exitosas, los mayores inventores y los más importantes en general, son personas blancas heteroxesuales, no podemos esperar que los algoritmos creen la sociedad del cielo arcoíris que nos prometieron, ya que lo único que tendremos será una sociedad más discriminatoria que nunca, eso sí, la que discrimina será una máquina, así que, ¿tampoco es tan grave, no?

Comentarios

|

Este sitio web utiliza tecnologías de marketing y seguimiento. Si optas por no aceptarlas, estarás excluyendo todas las cookies, excepto las necesarias para el funcionamiento del sitio web. Ten en cuenta que algunos productos puede que no funcionen sin las cookies de seguimiento. Optar por no usar cookies |

Fuente RSS

Fuente RSS